Нейросети впечатляют. Но важно понимать, как ими пользоваться безопасно

Кажется, что ИИ — это магия. Нажал кнопку — получил готовый текст. Описал картинку — получил шедевр. Загрузил документ — получил идеальное резюме. Но за этой простотой — целый пласт вопросов, ограничений и рисков.

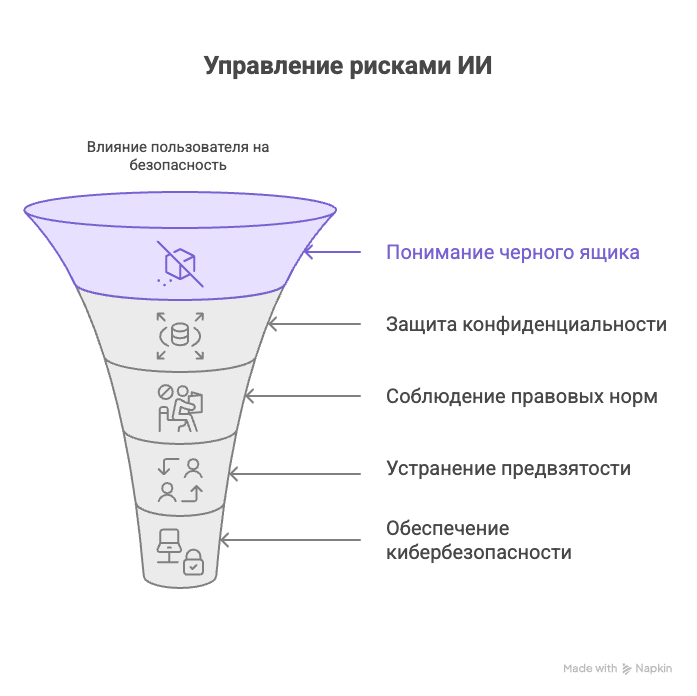

5 рисков, о которых стоит знать каждому

1. «Чёрный ящик» и непрозрачность решений

ИИ не объясняет, почему пришёл к конкретному результату. Вы видите запрос и ответ — но не видите логику, по которой модель сделала выбор.Или видите, но минимально можете на нее влиять.

Это снижает доверие, особенно в чувствительных сферах: HR, финансы, медицина.

Пример: нейросеть оценила кандидатов и «решила» отказать — без пояснений

Важно знать: в России пока нет отдельного закона, регулирующего ответственность ИИ. Ответственность остаётся на человеке, который использует результаты модели.

Как защитить себя при работе с ИИ?

«Какие факты ты использовал для вывода?»

- Запрашивайте пояснение прямо у модели. Такие уточнения тренируют «прозрачное мышление» и помогают выявлять ошибки.

«Какие факты ты использовал для вывода?»

- Проверяйте логику, не только текст. Несостыковки — сигнал, что модель «угадывает», а не рассуждает.

- Выбирайте инструменты, где видно “ход мыслей” модели. Примеры думающих моделей: ChatGPT, Gemini или Claude. Они дают пояснения к шагам — это безопаснее, чем «чёрный ящик» без объяснений.

2. Предвзятость моделей

ИИ учится на реальных данных, а они часто не нейтральны. Если в обучающих выборках есть перекосы — нейросеть их повторяет.

Мировой пример: генераторы изображений чаще показывают женщин в ролях помощников, а мужчин — руководителей.

Российский контекст: русскоязычные модели хуже понимают региональные акценты или нестандартную лексику. В маркетинге это может приводить к шаблонным, «плоским» текстам.

Как защититься от предвзятости?

«Приведи примеры из разных отраслей»

«Добавь примеры из России»

«Приведи примеры из разных регионов и возрастных групп»

«Сделай описание нейтральным по полу и происхождению»

- Проверяйте нейросеть на разнообразных примерах. Не берите один запрос и один ответ. Попробуйте задать ту же задачу с разными формулировками, ролями и контекстами.

- Используйте несколько источников. Разные модели обучались на разных данных, и расхождения покажут, где возможна предвзятость

- Если ответ однобокий — уточните запрос

«Приведи примеры из разных отраслей»

«Добавь примеры из России»

«Приведи примеры из разных регионов и возрастных групп»

«Сделай описание нейтральным по полу и происхождению»

3. Конфиденциальность и безопасность данных

Каждый запрос — это потенциальный переданный фрагмент информации. Если вы вводите личные, корпоративные или клиентские данные — они могут попасть в систему. Нейросети могут «переобучаться» на пользовательских данных, а значит, часть ваших запросов — останется в модели.

Российский контекст: Закон № 152-ФЗ обязывает хранить данные граждан РФ на локальных серверах. Использование зарубежных моделей без понимания рисков — нарушение.

Как защитить себя при при работе с ИИ?

- обрабатывайте и храните данные локально

- очищайте и анонимизируйте данные для защиты конфиденциальности

- описывайте ситуацию нейтрально

4. Правовая неопределенность

Кто владеет текстом или картинкой, созданной ИИ? Можно ли использовать этот контент в коммерческих целях?

Российский контекст: пока в РФ нет чёткой правовой базы, но появляются стандарты и ГОСТы на контент, созданный с участием ИИ.

Как минимально поддерживать юридическую чистоту?

- Подпишитесь на обновления от Минцифры, Гарант, Консультант+ — там появляются реальные требования и ГОСТы к AI-контенту (например, маркировка, ответственность, защита данных).

- Используйте официальные или лицензированные источники контента (Pixabay, Unsplash)

- Уточняйте юридические аспекты перед публикацией контента, читайте Политики использования моделей и сервисов с ии

- Сохраняйте исходные запросы и результаты — это поможет подтвердить, что вы создавали материал самостоятельно.

- Если публикуете результат (на сайте, в курсе, отчёте) — добавляйте пометку «создано с использованием нейросети» (практика, рекомендованная многими компаниями и СМИ).

5. Киберугрозы и атаки на ИИ-системы

ИИ-модели можно обмануть, как обычный софт. Существуют атаки, при которых во входные данные добавляют «шум» — и модель выдаёт ложный ответ («adversarial attacks» — изменение входных данных для манипуляции результатом)

Базовые правила защиты от киберугроз

- Используйте только официальные сервисы нейросетей

- Регулярно очищайте историю запросов

- Не устанавливайте расширения из неизвестных источников.

- Ограниченно давайте доступ агентов к своим данным и с осторожностью используйте коннекторы

Российский контекст: хакеры уже пробуют вмешиваться в работу генеративных моделей, обучая их вредным шаблонам.

Мини-чек-лист безопасной работы с нейросетью

Чтобы вы чувствовали себя уверенно, а не наудачу использовали сложную технологию. Прежде чем поручать нейросети важные задачи, стоит задать себе несколько простых вопросов. Если хотя бы на 3 из них вы не уверены — лучше использовать нейросеть осторожно или с дополнительной проверкой.

Я понимаю, как работает этот инструмент

Если нет — начните с простых задач и разберите механику на примерах.

Я не ввожу личные или конфиденциальные данные

Ни паролей, ни фамилий, ни каких либо идентифицирующих меня или компанию. Если сомневаетесь — уточните у юриста или руководителя.

Я проверяю результат перед публикацией

Нейросети ошибаются — это не баг, а особенность

Я понимаю, что ответственность за результат — на мне

ИИ — помощник, а не заменитель решений.

Вывод: цифровая осознанность — это новая норма

ИИ — не угроза, если понимать, как он работает.

Главная защита — знание и практика.

Начать безопасно можно с бесплатного мини-курса «ИИ для новичков: старт за 1 час» — 4 урока, 27 практических задач и 5 проверенных сервисов.

Затем изучите базовые принципы и разберите ошибки пройдя мини-курс «Как правильно задавать вопросы AI», а если хотите внедрить ИИ в рабочие процессы — закажите тариф с сопровождением.